2025,AI泡沫破裂的一年?

GoUpSec点评:企业对AI的期望很高,但现实很残酷,被资本和市场寄予厚望的AI代理似乎并不能帮企业节省文案、编程、设计、网络安全等专业服务的成本。相反,一些匆忙部署AI替代人力的企业,不仅没有品尝到“AI红利”,反而“花钱买罪受”,在研发、营销环节和企业的知识系统内产生了大量AI生成的垃圾和错误内容,需要花高价聘请专业人士手动清理。

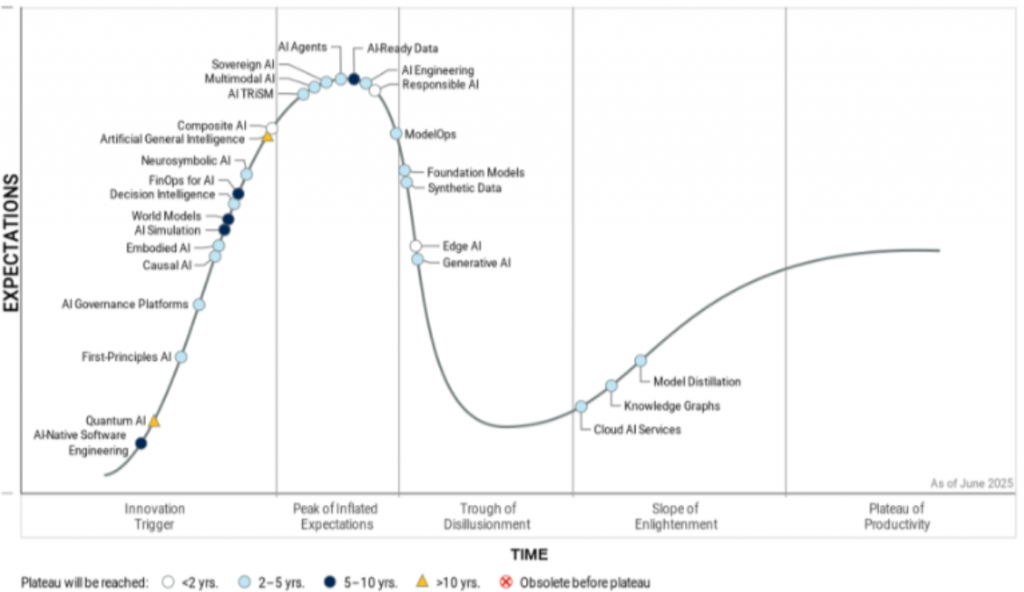

2025年,生成式AI代理的泡沫正在破裂,企业开始为当初急于用AI替代人力而付出高昂代价。Gartner最新的《2025Q2CIOPulse》显示,74%的企业对AI代理的试点结果感到“令人失望或缺乏说服力”,平均投资回报率不足1.4倍。

而现实中,AI的问题不仅体现在投资回报率上,还在于其频繁的错误引发了对人类专业技能的重新依赖。

企业“花钱买罪受”,“修补AI”成了一门大生意

BBC最新调查显示,一批专门“修复AI错误”的自由职业者和公司正在兴起,他们凭借擅长纠正AI产出的错误内容而获得可观收入。美国营销经理Sarah Skidd 透露,自己近期受雇于一家广告公司,紧急重写一份客户文案,因为他们试图用AI聊天机器人“省钱”制作初稿,但结果平庸、空洞,让人索然无味。Skidd最终花费20小时从零开始重写,以每小时100美元的费率计算,这份“AI省钱文案”最终成本高达2000美元——远高于直接请人撰写的费用。

AI代理正处于Garnter炒作周期的波峰 来源:Gartner

英国数字营销机构Create Designs联合创始人Sophie Warner也分享了类似经历:越来越多客户在使用AI工具修改网站后,反而导致功能瘫痪、页面崩溃,不得不求助于专业人员“善后”。在一例中,一位客户因为ChatGPT生成的一行错误代码,导致网站瘫痪三天,并支付了近500美元的修复费用——而该更新若由专业开发者处理,仅需15分钟即可完成。

Warner直言:“AI看似便捷廉价,但几乎不会考虑品牌调性、目标人群或转化设计。它无法替代人类的专业经验和语境理解。”

AI落地的三大困境

Gartner报告与一线案例共同揭示,AI在大规模应用中面临三大核心问题:

- 幻觉与错误:AI输出自信却错误的信息,在营销、内容制作、代码编写中尤为常见,导致反复修订和生产成本增加。

- 无法顺畅交接:AI难以与人或其他系统无缝对接,尤其在涉及跨部门或复杂流程时效率大打折扣。

- 安全和合规风险:AI代理需要访问企业系统与敏感数据,但模型不具备必要的安全机制,容易引发重大数据泄露或合规问题。

从“AI万能”回归对专业人才的尊重

在2023~2024年的AI热潮中,大批企业削减人员、押注自动化,被誉为“AI员工”的代理迅速席卷各行业。然而如今,越来越多公司发现:AI不仅未能带来预期效率,还要额外支出修复错误。

BBC的采访案例和Gartner调研形成呼应——两位受访专家都对AI本身并无敌意,但对市场“AI能全面取代人类”的误解感到沮丧。Sarah Skidd表示:“也许我太乐观,但我认为只要足够专业的人,在AI时代也不会失业。”而Gartner 高级副总裁Mary Mesaglio总结称:“我们正处于生成式炒作周期的幻灭期底部,泡沫破裂后的理性回归将促使企业重新重视人类专业能力。”